In diesem Artikel behandeln wir folgende Themen:

- Was sind Job-APIs, Datensätze und DIY-Scraping und wie wählen Sie den richtigen Ansatz für Ihren Anwendungsfall aus?

- Die besten Jobdaten-APIs und -Anbieter im Jahr 2026 mit einer vollständigen Aufschlüsselung der Funktionen, Quellen, Preise und Einschränkungen

- Wie Sie den richtigen Anbieter für Ihren spezifischen Anwendungsfall finden, egal ob Sie eine Jobbörse aufbauen, ein KI-Modell trainieren oder Marktforschung betreiben

💡 Bright Data bietet auch gebrauchsfertige Datensätze und verwaltete Datendienste

TLDR: Alle Anbieter auf einen Blick

| Anbieter | Am besten geeignet für | Quellen | Aktualität | Kostenlose Option | Einstiegspreis |

|---|---|---|---|---|---|

| Bright Data | Unternehmen, KI/ML, volle Flexibilität | LinkedIn, Indeed, Glassdoor + mehr | Echtzeit (API); periodisch (Datensätze) | 7 Tage kostenlose Testversion | 2,50 $/1.000 Datensätze (Datensätze); 0,75 $/1.000 Datensätze (Scraper-API) |

| Coresignal | LinkedIn-Tiefe + Mitarbeiteranreicherung | LinkedIn, Indeed, Glassdoor, Wellfound | Echtzeit-API; 6-stündige Aktualisierung | 14-tägige Testversion (200 Credits) | 49 $/Monat (API); 1.000 $ (Datensätze) |

| TheirStack | Multi-Source-Abdeckung, Vertriebsinformationen | Über 315.000 Quellen + ATS-Plattformen | Nahezu in Echtzeit (1 Min.) | 200 Credits/Monat kostenlos | 59 $/Monat |

| Oxylabs | Benutzerdefinierte Scraping-Pipelines | Indeed, Glassdoor, StackShare | Konfigurierbar | 1-wöchige Testversion (5.000 Ergebnisse) | 49 $/Monat (API); 1.000 $/Monat (Datensätze) |

| SerpApi | Google Jobs-Daten zu einem günstigen Preis | Google Jobs (aggregiert) | Echtzeit | 100 Suchanfragen/Monat kostenlos | 25 $/Monat |

| LinkUp | Saubere Direktquelle, Unternehmensrecherche | Karriere-Seiten von Arbeitgebern | Täglich | Keine | Benutzerdefiniert (Demo erforderlich) |

| Revelio Labs | Workforce Intelligence | Mehrere Quellen + Karriereseiten | Täglich | Demo-gesteuerte Testversion | Individuell |

| Techmap | Historische Massendaten, budgetbewusst | Mehrere Quellen (nicht spezifiziert) | Regelmäßig | Kostenlose Probe + Testversion | 1 $/1.000 Stellen (API) |

Ganz gleich, ob Sie eine Jobbörse aufbauen, ein Sales-Intelligence-Tool betreiben oder Marktforschung betreiben – die Methode, mit der Sie Jobdaten sammeln, bestimmt die Obergrenze Ihres Projekts. Wenn Sie einen Scraper von Grund auf neu erstellen, müssen Sie sich mit allen damit verbundenen Wartungsproblemen herumschlagen: defekte Parser bei Umstrukturierungen von Websites, CAPTCHA-Wettläufe, Deduplizierungslogik, die Sie selbst um 2 Uhr morgens geschrieben haben. Mit dem richtigen API- oder Datensatzanbieter verschwinden diese Probleme.

Dieser Leitfaden bringt Klarheit. Im Folgenden finden Sie die besten Job-APIs und Datenanbieter im Jahr 2026, was sie tatsächlich liefern, was sie kosten, wo ihre Schwächen liegen und für welchen Anwendungsfall sie jeweils am besten geeignet sind.

API vs. Datensatz vs. Scraper: Wählen Sie zuerst Ihren Ansatz

Bevor Sie Anbieter bewerten, müssen Sie sich darüber im Klaren sein, welche Art von Produkt Sie kaufen möchten. Die drei Optionen funktionieren sehr unterschiedlich.

Mit Job-APIs können Sie die Datenbank eines Anbieters in Echtzeit über REST-Endpunkte abfragen. Sie senden eine Anfrage und erhalten strukturierte JSON-Daten zurück. Am besten geeignet für: Jobbörsen, die eine Live-Suche benötigen, Verkaufstools, die bei neuen Stellenanzeigen ausgelöst werden, und Anwendungen, bei denen Latenz eine Rolle spielt.

Vorkonfigurierte Datensätze sind Massenexporte von zig oder hunderten Millionen Datensätzen, die an Ihren Cloud-Speicher (S3, GCS, Azure, Snowflake) geliefert werden. Sie laden sie einmal herunter oder abonnieren regelmäßige Aktualisierungen. Am besten geeignet für: KI/ML-Training, historische Massenanalysen und Workflows, bei denen Sie Daten offline verarbeiten. Die Kosten pro Datensatz sind deutlich niedriger als bei API-Aufrufen in großem Umfang.

DIY-Web-Scraping bedeutet, dass Sie alles selbst erstellen und warten. Tools wie die Proxys von Bright Data können die Infrastruktur-Ebene übernehmen, aber das Parsing, die Deduplizierung und die Schema-Normalisierung müssen Sie weiterhin selbst übernehmen. Am besten geeignet für: Nischenquellen, die noch kein Anbieter abdeckt, oder wenn Sie maximale Kontrolle benötigen. Die laufende Wartung kostet in der Regel mehr als 20 Stunden pro Monat und Scraper-Ziel. Um einen tieferen Einblick in die damit verbundenen Anforderungen zu erhalten, lesen Sie die häufigsten Herausforderungen beim Erstellen eigener Web-Scraper.

Eine praktische Faustregel: Wenn Sie weniger als 50.000 Datensätze pro Monat und Echtzeit-Zugriff benötigen, ist eine API in der Regel kostengünstiger und einfacher. Oberhalb dieses Volumens werden Datensätze kostengünstiger. Wenn Ihre Zielquellen in keinem Anbieter-Katalog vorhanden sind, erstellen Sie sie mit Infrastruktur-Tools.

Die besten Job-APIs und Datenanbieter im Jahr 2026

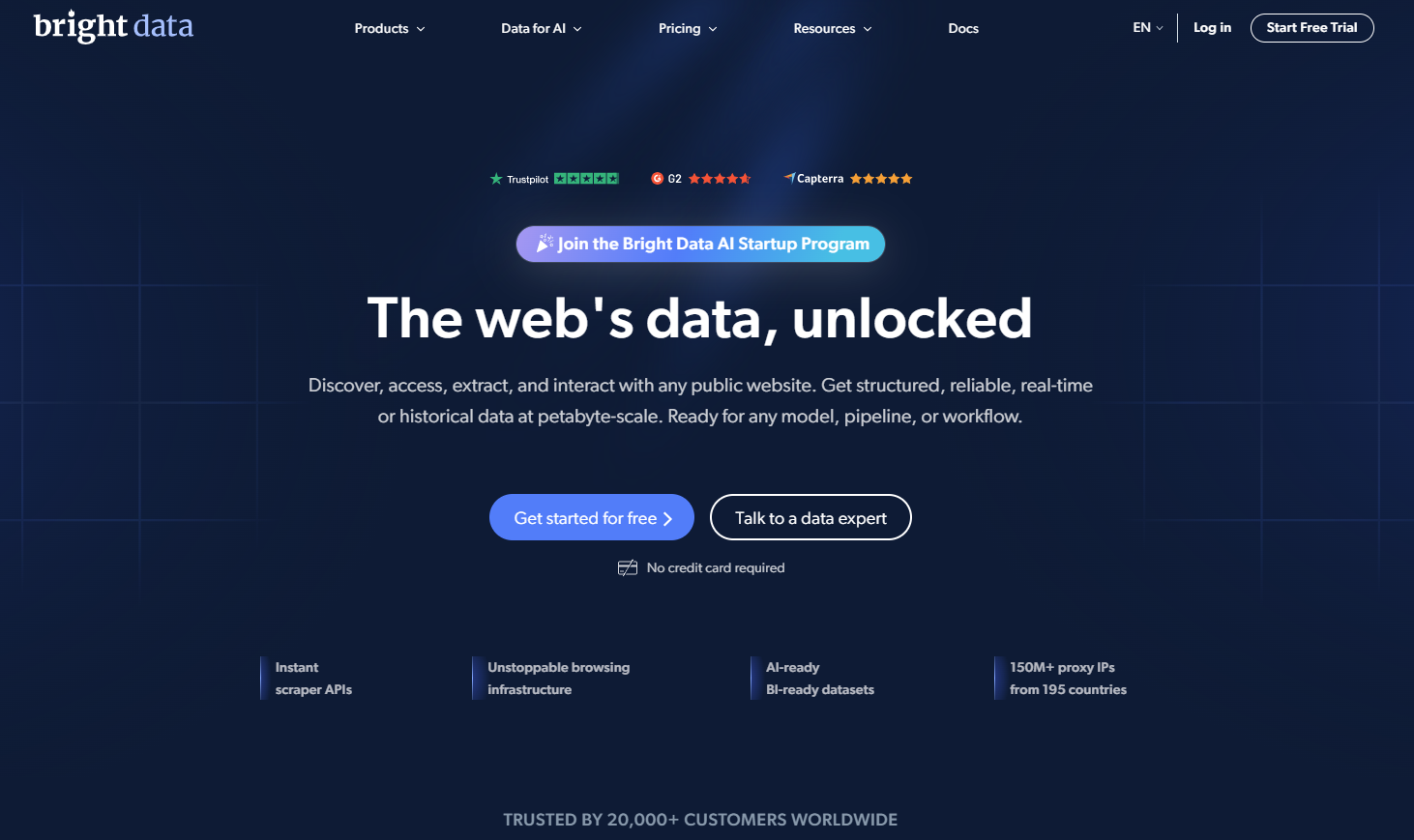

1. Bright Data: Insgesamt am besten für Flexibilität auf Unternehmensebene

Bright Data bietet kein einzelnes Job-Produkt an. Es bietet ein ganzes Ökosystem. Sie können vorgefertigte Datensätze kaufen, über dedizierte Scraper-APIs in Echtzeit scrapen, mit Scraper Studio (einem No-Code-Scraper) benutzerdefinierte Pipelines erstellen oder historische Snapshots aus dem Webarchiv abrufen. Diese Flexibilität unterscheidet Bright Data von allen anderen Anbietern auf dieser Liste.

Verfügbare Datensätze und Scraper:

- LinkedIn Scraper API

- Glassdoor Scraper API

- Indeed Scraper API

- LinkedIn-Stellenanzeigen: über 57 Millionen Datensätze

- Indeed-Stellenangebote: über 46 Millionen Datensätze

- Glassdoor-Stellenangebote: über 36 Millionen Datensätze

Und vieles mehr.

Jeder Datensatz wird in den Formaten JSON, CSV, NDJSON, JSON Lines oder Parquet geliefert und kann direkt an S3, Snowflake, Google Cloud, Azure oder SFTP übermittelt werden. Sie können monatliche, vierteljährliche oder halbjährliche Aktualisierungen abonnieren oder einen einmaligen Snapshot erwerben. Mit der KI-Filterfunktion können Sie Ihre Datenanforderungen in einfachem Englisch beschreiben und Filter automatisch anwenden lassen – eine echte Zeitersparnis, wenn Sie 86 Millionen Datensätze auf das reduzieren, was Sie tatsächlich benötigen.

Für den Echtzeitzugriff kostet die LinkedIn Jobs Scraper API ab 1,50 $/1.000 Datensätze bei Pay-as-you-go oder 0,75 bis 0,98 $/1.000 Datensätze bei einem Monatlichen Abonnement. Spezielle Scraper gibt es auch für Indeed- und Glassdoor-Stellenangebote.

Was Bright Data auszeichnet:

- Vollständige GDPR- und CCPA-Konformität mit ISO 27001-Zertifizierung, sodass das rechtliche Risiko auf Bright Data und nicht auf Ihr Team übergeht

- Über 70 Integrationen, darunter Zapier, n8n, Make, LangChain, LlamaIndex und CrewAI

- KI-optimierte Datensätze mit Code-Beispielen für die sofortige Integration von ChatGPT und Claude

- Offizieller MCP-Server für KI-Agent-Frameworks

- Kostenlose Beispieldatensätze in JSON/CSV, bevor Sie sich zum Kauf entschließen

- Rund um die Uhr Support durch über 80 Datenexperten mit dedizierten Account Managern in großem Umfang

Preise: Datensätze ab 2,50 $/1.000 Datensätze (Mindestbestellwert 250 $). Scraper-APIs ab 0,75 $/1.000 Datensätze im Abonnement. 7-tägige kostenlose Testversion verfügbar.

Am besten geeignet für: Unternehmen, KI-/ML-Teams und Forscher, die eine Abdeckung aus mehreren Quellen ohne Infrastruktur-Overhead und mit integrierter vollständiger Compliance benötigen.

Nicht geeignet, wenn: Sie weniger als 5.000 Datensätze benötigen und eine kostenlose Stufe wünschen. In diesem Fall sind TheirStack oder SerpApi besser geeignet.

2. Coresignal: Am besten geeignet für LinkedIn-lastige Workflows mit Mitarbeiterkontext

Das Hauptverkaufsargument von Coresignal ist die Tiefe der LinkedIn-Daten in Kombination mit Mitarbeiter- und Unternehmensinformationen auf einer einzigen Plattform. Der Multi-Source-Job-Datensatz umfasst mehr als 399 Millionen Stellenanzeigen von LinkedIn, Indeed, Glassdoor und Wellfound, die dedupliziert und mit mehr als 65 Datenpunkten pro Stelle angereichert sind, darunter Informationen zu Personalvermittlern, Angaben zur Betriebszugehörigkeit und Unternehmensdaten. Für Teams, die Alternativen evaluieren, kann ein Vergleich der besten Coresignal-Alternativen helfen, zu beurteilen, wo es im Vergleich zu anderen Anbietern steht.

Die API funktioniert nach einem Credit-System: 1 Credit entspricht 1 Datensatz. Das Multi-Source-Jobs-Produkt kostet aufgrund der Anreicherung 2 Credits pro Datensatz, was die Kosten verdoppelt, Ihnen aber die Erstellung von Pipelines zur Deduplizierung und Unternehmenszuordnung erspart.

Preisstufen (API):

- Starter: ab 49 $/Monat (250 Credits zum Sammeln / 500 Credits zum Suchen)

- Pro: ab 800 $/Monat (10.000 Sammel-/20.000 Such-Credits)

- Premium: ab 1.500 $/Monat (50.000 Sammel-/150.000 Such-Credits)

- Datensätze: ab 1.000 $

Die Kosten steigen schnell an. Bei zehntausend Aufträgen pro Monat erreichen Sie die Pro-Stufe für 800 $, was 0,08 $ pro Auftrag entspricht. Wenn Sie angereicherte Datensätze aus mehreren Quellen zu je 2 Credits benötigen, verdoppelt sich dieser Betrag. In den meisten Anwendungsfällen berechnet Coresignal das 2- bis 10-fache dessen, was Alternativen für gleichwertige Rohdaten verlangen. Der Aufpreis ist gerechtfertigt, wenn Sie Kontaktdaten von Personalvermittlern und Anreicherung aus mehreren Quellen in einem einzigen Anruf benötigen; er ist jedoch nicht gerechtfertigt, wenn Sie nur Rohdaten von Stellenangeboten wünschen.

Was Coresignal gut macht:

- Umfassende LinkedIn-Abdeckung (über 349 Millionen LinkedIn-Stellenangebote)

- 14-tägige kostenlose Testversion mit 200 Collect-Credits

- KI-fähige Datensätze mit MCP-Serverintegration

- DSGVO- und CCPA-konform

- Mitarbeiterdaten neben Jobdaten, was unter den Anbietern in dieser Liste einzigartig ist

Einschränkungen:

- Höhere Kosten in jeder Stufe im Vergleich zu Alternativen

- Zweistufige API (Suchen + Sammeln) verursacht Reibungsverluste im Vergleich zu Anbietern mit Ein-Schritt-Aufruf

- Keine integrierte Benutzeroberfläche zum Durchsuchen von Daten ohne Programmierung

Am besten geeignet für: Sales-Intelligence-Teams, die neben Jobdaten auch Kontakte zu Personalvermittlern benötigen; Unternehmenskunden, die LinkedIn-Anreicherung in großem Umfang benötigen und über das entsprechende Budget verfügen.

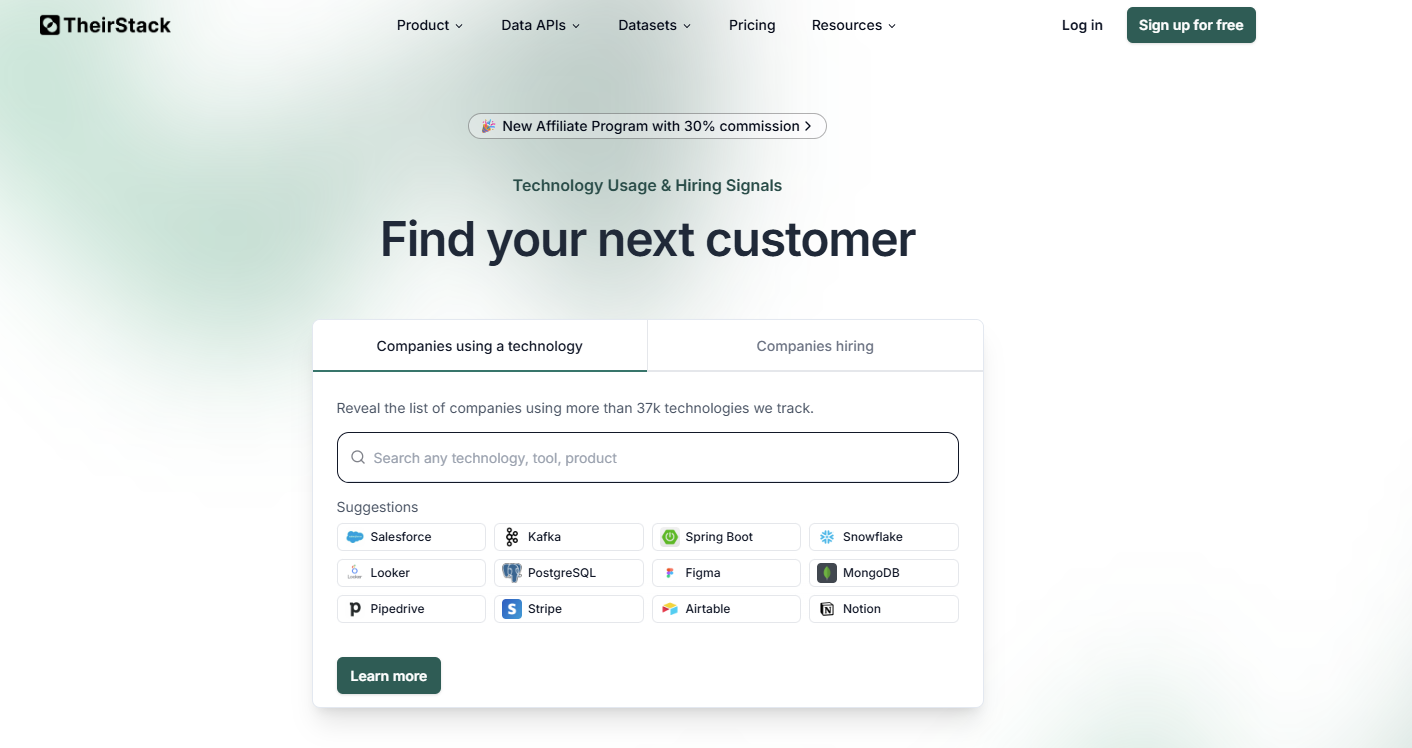

3. TheirStack: Am besten geeignet für Multi-Source-Abdeckung zu niedrigen Kosten

TheirStack aggregiert Stellenanzeigen aus über 315.000 Quellen, darunter LinkedIn, Indeed, Glassdoor und über 16.000 ATS-Plattformen wie Greenhouse, Lever und Workable, und dedupliziert sie automatisch. Die Datenbank wird minütlich aktualisiert. Das Besondere an TheirStack ist die Möglichkeit, Stellenangebote nach Unternehmensmerkmalen zu filtern: Größe, Finanzierungsphase, Branche und Tech-Stack. Sie können „Fintech-Unternehmen der Serie B, die ML-Ingenieure einstellen” finden, ohne selbst eine Anreicherungspipeline aufbauen zu müssen. Wenn man die zugrunde liegenden firmografischen Daten versteht, auf denen diese Filter basieren, wird klar, warum diese Funktion für vertriebsorientierte Arbeitsabläufe so wertvoll ist.

Preise:

- Kostenlos: 200 Credits/Monat

- 59 $/Monat: 1.500 Credits (~1.500 Stellenangebote)

- 169 $/Monat: 10.000 Credits

- 400 $/Monat: 50.000 Credits

- 1.500 $/Monat: 1.000.000 Credits

Mit Kosten von etwa 0,0015 bis 0,039 US-Dollar pro Auftrag, je nach Tarif, gehört TheirStack zu den günstigsten Optionen für die Abdeckung mehrerer Quellen. Nicht genutzte Credits können bis zu 12 Monate lang übertragen werden.

Was TheirStack auszeichnet:

- Nahezu Echtzeit-Updates jede Minute

- Integrierte Deduplizierung über alle 315.000 Quellen hinweg

- Webhooks für Jobbenachrichtigungen in Echtzeit

- Filtern von Jobs nach Unternehmensdaten und Tech-Stack in einem einzigen API-Aufruf

- No-Code-Web-App für nicht-technische Benutzer

Einschränkungen:

- Keine Mitarbeiterdaten neben Stellenangeboten

- Weniger etabliert als Bright Data oder Coresignal für die Beschaffung in Unternehmen

Am besten geeignet für: Vertriebsteams, Entwickler von Jobbörsen und Entwickler, die eine breite Abdeckung, niedrige Kosten und integrierte Deduplizierung wünschen, ohne mehrere Anbieter miteinander verbinden zu müssen.

4. Oxylabs: Am besten geeignet für Teams, die benutzerdefinierte Datenpipelines erstellen

Oxylabs befindet sich auf derselben Ebene wie Bright Data: ein großer Infrastrukturanbieter mit speziellen Produkten für das Job-Scraping. Seine Datensätze umfassen Indeed, Glassdoor und StackShare, mit Lieferoptionen über AWS S3, Google Cloud, Azure und SFTP. Die Jobs Web Scraper API unterstützt benutzerdefinierte Parser, einen integrierten Webcrawler und den OxyCopilot-Assistenten, der Anweisungen in natürlicher Sprache in funktionierenden API-Code in Python, Node.js und mehr umwandelt.

Was Oxylabs bietet:

- Standard-Datensätze mit Stellenanzeigen von großen Jobbörsen

- Benutzerdefinierte Datensätze, die nach Ihren Vorgaben erstellt werden

- Engagierte Account Manager mit Slack-Kanalzugang

- Einwöchige Testversion mit 5.000 Ergebnissen für die Scraper-API

Preise:

- Standard-Datensätze für Stellenanzeigen: ab 1.000 $/Monat

- Scraper-API: ab 49 $/Monat (2 $/1.000 Ergebnisse)

- Benutzerdefinierte Datensätze: Kontakt Vertrieb

Am besten geeignet für: Teams mit technischen Ressourcen, die rohe, unverarbeitete Jobdaten aus bestimmten Quellen benötigen, oder Unternehmen, die bereits die Proxy-Infrastruktur von Oxylabs nutzen. Wenn Sie noch nicht zum Oxylabs-Ökosystem gehören, bietet Bright Data vergleichbare Produkte mit mehr berufsspezifischen Abdeckungsoptionen.

5. SerpApi: Am besten geeignet für Google Jobs-Daten

SerpApi ist in erster Linie ein SERP-API-Anbieter, aber sein Google Jobs-Endpunkt ist besonders erwähnenswert. Google Jobs aggregiert Stellenanzeigen aus Tausenden von Quellen, darunter Indeed, LinkedIn, ZipRecruiter und Workday, und mit SerpApi können Sie diese Daten programmgesteuert abrufen. Sie erhalten die Stellenbezeichnung, das Unternehmen, den Standort, die Beschreibung, Links zur Bewerbung, das Gehalt (sofern Google dies anzeigt) und Filter für die Art der Beschäftigung, das Datum der Veröffentlichung und Remote-Arbeit.

Preise:

- Kostenloser Tarif: 100 Suchanfragen/Monat

- Starter: 25 $/Monat (500 Suchanfragen)

- Entwickler: 75 $/Monat (5.000 Suchanfragen)

- Produktion: 150 $/Monat (15.000 Suchanfragen)

- Big Data: 275 $/Monat (30.000 Suchanfragen)

Was SerpApi so nützlich macht:

- Greift auf die aggregierten Jobdaten von Google zu und bietet so eine sehr breite Quellenabdeckung per Proxy

- Einfache REST-API mit ausgezeichneter Dokumentation

- 99,977 % Verfügbarkeit

- Keine Infrastruktur zu verwalten

Einschränkungen: Sie sind auf die von Google Jobs angezeigten Ergebnisse beschränkt, ohne historische Daten, ohne Massen-Downloads und ohne Deduplizierungskontrolle. Es eignet sich hervorragend für die Erstellung von Jobsuchfunktionen, die das widerspiegeln, was Google anzeigt. Es ist kein Ersatz für einen dedizierten Jobdatenanbieter, wenn Sie Skalierbarkeit oder benutzerdefinierte Filter benötigen.

Am besten geeignet für: Entwickler, die mit begrenztem Budget Jobsuchfunktionen erstellen und schnell eine breite Abdeckung benötigen, oderfür alle Anwendungen, bei denen „Jobs, die Google kennt” als Datenquelle ausreichen. Die Google Search API von Bright Data ist einen Vergleich wert, wenn Sie neben den Jobdaten eine tiefere SERP-Anpassung benötigen.

6. LinkUp: Am besten geeignet für saubere Unternehmensdaten aus Unternehmensquellen

LinkUp crawlt seit 2007 direkt von den Karriereseiten der Arbeitgeber, ohne Jobbörsen und ohne LinkedIn-Scraping. Das Ergebnis sind saubere Daten ohne Spam von Personalvermittlern, ohne erneut gepostete Stellenangebote und ohne Duplikate auf verschiedenen Plattformen. Die Datenbank enthält mehr als 315 Millionen historische Stellenanzeigen aus 195 Ländern, mit etwa 5 Millionen aktiven Angeboten pro Tag.

Für qualitätsorientierte Anwendungsfälle wie Wirtschaftsforschung, Personalprognosen oder die Generierung von Hedgefonds-Signalen ist die Direktquellen-Methodik von LinkUp von Bedeutung. Das Unternehmen unterhält eine „Broken Scrapes Queue”, die Unternehmen kennzeichnet, deren Karriereseiten sich geändert haben, und stellt die Daten für börsennotierte Unternehmen in der Regel innerhalb von 24 Stunden wieder her.

Einschränkungen: Nur für Unternehmen, keine Selbstbedienungsoption, keine öffentlichen Preise und keine kostenlose Stufe. Ende 2024 von GlobalData übernommen, was eine gewisse Unsicherheit hinsichtlich der Produktrichtung mit sich bringt. Für eine Demo und ein individuelles Angebot müssen Sie den Kontakt zum Vertrieb herstellen.

Am besten geeignet für: Große Unternehmen und Forschungseinrichtungen, die Arbeitsmarktanalysen durchführen und saubere Daten aus direkten Quellen mit langer historischer Tiefe benötigen.

7. Revelio Labs: Am besten geeignet für Workforce Intelligence

Revelio Labs positioniert sich eher als Workforce-Intelligence-Plattform denn als Jobdaten-API. Der COSMOS-Datensatz umfasst mehr als 4,1 Milliarden aktuelle und historische Stellenanzeigen von 6,6 Millionen Unternehmen, die dedupliziert und mit Kompetenztaxonomien, Berufsklassifikationen und Daten zur Arbeitskräftedynamik, einschließlich Mitarbeiterzahl, Einstellungsquoten und Fluktuationsraten nach Unternehmen und Abteilung, normalisiert wurden.

Diese Tiefe der Anreicherung geht weit über das Angebot anderer Anbieter hinaus, ist jedoch preislich und paketmäßig auf institutionelle Käufer ausgerichtet. Es gibt keinen Selbstbedienungszugang, keine öffentlichen Preise und es ist eine Demo erforderlich, um loszulegen. Wer diese Kategorie angereicherter Daten zusammen mit Mitarbeitererkenntnissen bewertet, findet möglicherweise auch Wert darin, die besten Anbieter von Mitarbeiterdaten als ergänzende Referenz zu prüfen.

Am besten geeignet für: HR-Analyseteams, akademische Forscher und Unternehmensstrategen, die nicht nur reine Stellenanzeigen, sondern auch Informationen über die Belegschaft benötigen.

8. Techmap / jobdatafeeds.com: Die beste Budgetoption für historische Massendaten

Techmap betreibt jobdatafeeds.com und bietet Job-Datenfeeds und historische Datensätze, die bis ins Jahr 2020 zurückreichen. Mit etwa 6,7 Millionen neuen Stellenangeboten pro Monat weltweit und einer API zum Preis von 1 $ pro 1.000 Stellenangeboten gehört es zu den kostengünstigsten Optionen für große Datenmengen. Historische Datensätze sind ab 2.400 $ pro Land erhältlich.

Zu den Datenformaten gehören JSON, CSV, Parquet, XML, JSON-LD und ATOM. Vor der Entscheidung stehen eine kostenlose Testversion und ein kostenloses Beispiel für Datensätze zur Verfügung.

Am besten geeignet für: Preisbewusste Entwickler und Forscher, die umfangreiche historische Daten benötigen und mit einem weniger etablierten Anbieter zufrieden sind.

So wählen Sie den richtigen Anbieter

Aufbau einer Jobbörse oder eines Aggregators: Bright Data-Datensätze für die anfängliche Massenladung, TheirStack oder die dedizierten Scraper-APIs von Bright Data für laufende neue Einträge. Die integrierte Deduplizierung von TheirStack spart wertvolle Entwicklungszeit, wenn Ihre Jobbörse Daten aus vielen Quellen bezieht.

Sales Intelligence: Die Unternehmensattributfilter von TheirStack (Branche, Finanzierung, Tech-Stack) sind hier besonders leistungsstark. Bright Data eignet sich gut für große Datenmengen. Coresignal bietet einen Mehrwert, wenn die Kontaktdaten von Personalvermittlern für Ihren Workflow wichtig sind. Einen umfassenderen Überblick über diesen Bereich finden Sie im Leitfaden zu den besten B2B-Datenanbietern.

Benötigen Sie LinkedIn-spezifische Daten in großem Umfang: LinkedIn-Datensätze und Scraper von Coresignal oder Bright Data. Coresignal geht tiefer in die Anreicherung; Bright Data ist bei hohen Volumina kostengünstiger und bietet umfassendere Lieferoptionen. Der Leitfaden zu den besten LinkedIn-Scraping-Tools deckt das gesamte Spektrum der Optionen für diesen Anwendungsfall ab.

Training eines KI-Modells: Die KI-fähigen Datenpakete von Bright Data mit LLM-optimierter Formatierung und nativen Integrationen für LangChain, CrewAI und LlamaIndex. Coresignal unterstützt ebenfalls ausdrücklich KI/ML-Workflows.

Durchführung von Marktforschung: LinkUp für saubere historische Daten aus erster Hand, die bis ins Jahr 2007 zurückreichen. Revelio Labs, wenn Sie neben den rohen Stellenanzeigen auch Daten zur Dynamik der Belegschaft (Mitarbeiterzahl, Fluktuation) benötigen. Das Webarchiv von Bright Data bietet mehr als 50 PB an historischen Daten als alternative Quelle für Längsschnittstudien.

Bei knappem Budget: Die kostenlose Stufe von TheirStack (200 Credits/Monat) ist für Prototyping wirklich nutzbar. Die 100 kostenlosen Suchanfragen von SerpApi decken kleine Experimente ab. Für die kostenpflichtige Nutzung zu minimalen Kosten bietet TheirStack mit 59 $/Monat das beste Preis-Leistungs-Verhältnis.

Sie nutzen bereits einen Anbieter für Scraping-Infrastruktur: Bleiben Sie bei Bright Data oder Oxylabs für Jobdaten. Sie profitieren von einer einfacheren Integration, einer bestehenden Kundenbeziehung und einem einzigen Anbieter für Infrastruktur und Datenprodukte.

Endgültiges Urteil

Es gibt keinen Anbieter, der für alle Anwendungsfälle gleichermaßen geeignet ist.

Bright Data ist die vielseitigste Option. Es deckt die meisten Quellen ab, bietet alle Liefermodelle (API, Scraper, Datensatz, benutzerdefiniert), lässt sich in über 70 Tools integrieren und bietet Compliance auf Unternehmensniveau mit ISO 27001-Zertifizierung. Wenn Sie sich nicht sicher sind, was Sie genau benötigen, können Sie mit dem Ökosystem von Bright Data mit einem Datensatz beginnen und auf Echtzeit-Scraping skalieren, ohne den Anbieter zu wechseln. Beginnen Sie mit dem Gratis-Test, um die Abdeckung zu überprüfen, bevor Sie sich festlegen.

TheirStack ist die beste Wahl für Entwickler und Vertriebsteams, die eine Abdeckung aus mehreren Quellen, integrierte Deduplizierung und nahezu Echtzeit-Aktualität wünschen, ohne Unternehmenspreise zu zahlen.

Coresignal ist die richtige Wahl, wenn Sie speziell die Tiefe von LinkedIn sowie Mitarbeiteranreicherung benötigen und bereit sind, einen Aufpreis für sauberere, reichhaltigere Daten zu zahlen, die sofort einsatzbereit sind.

SerpApi ist der schnellste Weg zu Google Jobs-Daten, wenn Sie eine Jobsuchfunktion entwickeln und keinen Zugriff auf historische Daten oder Datensätze benötigen.

Passen Sie den Anbieter an den Anwendungsfall an, testen Sie ihn mit kostenlosen Proben, bevor Sie sich für eine Skalierung entscheiden, und unterschätzen Sie nicht die technischen Kosten, die mit der Verwaltung aller Daten selbst verbunden sind.

Häufig gestellte Fragen

Was ist der Unterschied zwischen einer Job-API und einem Job-Datensatz?

Mit APIs können Sie Jobdaten in Echtzeit pro Anfrage abfragen. Datensätze sind Massenexporte von Millionen von Datensätzen, die an Ihren Speicher geliefert werden. APIs eignen sich für dynamische Anwendungen, Datensätze eignen sich für die Massenverarbeitung und bieten geringere Kosten pro Datensatz bei großem Umfang.

Wie viel kostet eine Job-API?

Kostenlose Tarife gibt es bei TheirStack (200 Credits/Monat) und SerpApi (100 Suchanfragen/Monat). Der kostenpflichtige Zugang reicht von 25 $/Monat für den Starter-Tarif von SerpApi bis zu 800 $/Monat für den Pro-Tarif von Coresignal. Die Scraper-APIs von Bright Data beginnen bei 0,75 $/1.000 Datensätze im Abonnement. Die Preise für Datensätze variieren je nach Volumen.

Kann ich historische Jobdaten abrufen?

Ja. Das Webarchiv von Bright Data bietet mehr als 50 PB an historischen Daten. Die Archive von TheirStack reichen bis ins Jahr 2021 zurück. LinkUp reicht bis ins Jahr 2007 zurück. Revelio Labs bis ins Jahr 2008. Techmap bis ins Jahr 2020. Die richtige Wahl hängt davon ab, wie weit Sie zurückgehen müssen und ob Sie Rohdaten oder angereicherte Personaldaten benötigen.

Wie lange dauert die Integration?

Eine grundlegende API-Integration (Authentifizierung, erste Anfrage, geparste Antwort) dauert mit guter Dokumentation nur wenige Minuten. Eine produktionsreife Integration, die Fehlerbehandlung, Rate-Limit-Management, Caching und Schema-Normalisierung umfasst, dauert in der Regel ein bis zwei Wochen. Die Integration von Datensätzen (Download auf S3, Laden in die Datenbank) kann mit Standard-Cloud-Tools oft an einem einzigen Tag durchgeführt werden.