Walmart.com ist 2026 der zweitgrößte US-amerikanische Online-Händler. Der E-Commerce-Umsatz überstieg im Geschäftsjahr 2026 150 Milliarden Dollar, ein Anstieg von 24 % im Jahresvergleich. Mit 267 Millionen Produkteinträgen ist eine manuelle Preis- und Katalogüberwachung in nennenswertem Umfang nicht möglich. Dieser Artikel bewertet die 8 besten Walmart-Scraper 2026. Die Einstufungen spiegeln die Benchmark-Erfolgsrate, Datenvollständigkeit, Anti-Bot-Fähigkeit und Preisgestaltung wider. Bright Data belegt Platz 1 mit einer Erfolgsrate von 98,44 % im unabhängigen Benchmark von Scrape.do unter 11 Anbietern.

In diesem Artikel werden wir über Folgendes sprechen:

- Was Walmart-Scraper sind und welche Haupttypen 2026 verfügbar sind

- Die 8 besten Walmart-Scraping-Tools, eingestuft nach Benchmark-Leistung und Preisgestaltung

- Wie Sie das richtige Tool für Ihre spezifischen Datenanforderungen auswählen

- Die technischen Herausforderungen, die Walmart zu einer der schwierigsten Einzelhandels-Websites zum Scrapen machen

- Warum Bright Data mit einer Erfolgsrate von 98,44 % in einem unabhängigen Benchmark unter 11 Anbietern Platz 1 belegt

TL;DR: Die besten Walmart-Scraper auf einen Blick

| Tool | Typ | Kostenlose Stufe | Startpreis | Am besten für |

|---|---|---|---|---|

| Bright Data | Dedizierte Walmart-API + Datensätze | Gratis testen, 1.000 Anfragen | 0,75 $/1K Anfragen + doppelte Mittel bis 500 $ | Bestes Gesamtpaket |

| Decodo | eCommerce-Scraping-API | 7-Tage-Test, 1.000 Ergebnisse | 0,25 $/1K Anfragen | Bestes Preis-Leistungs-Verhältnis |

| Oxylabs | Web-Scraper-API | 7-Tage-Test, 5.000 Ergebnisse | 2 $/1K Anfragen | Beste Datenvollständigkeit |

| Zyte API | KI-gestützte Scraping-API | 5 $ in kostenlosen Credits | 1 $+ pro Anfrage | Schnellste Antwortzeit |

| ScraperAPI | Dedizierte Scraping-API | 7-Tage-Test, 5.000 Credits | 49 $/Monat | Beste Budget-Option |

| SerpApi | Suchdaten-API | 250 Suchen/Monat kostenlos | ~50 $/Monat | Beste Suchdaten |

| Apify | Actor-basierte Plattform | Monatliche Compute-Credits | 49 $/Monat | Beste individuelle Workflows |

| Nimbleway | KI-gestützte Scraping-API | Test verfügbar | 3 $/1K Ergebnisse | Bestes Geo-Targeting |

Was ist ein Walmart-Scraper?

Ein Walmart-Scraper ist ein automatisiertes Tool, das strukturierte Produktdaten in großem Maßstab von Walmart.com extrahiert. Er ersetzt die manuelle Erfassung durch programmatischen Zugriff auf Produktinformationen im gesamten Katalog.

Scraper zielen auf Walmart-Produktseiten, Suchergebnisse, Kategorielisten und Rezensionsabschnitte ab. Sie liefern Preise, Verfügbarkeit, Verkäuferinformationen, Spezifikationen, Erfüllungsoptionen und Kundenbewertungsdaten. Die Ausgabe ist als JSON, CSV oder einem anderen analysefreundlichen Format für nachgelagerte Analysen und Systemaufnahmen strukturiert.

Walmarts 267 Millionen Produkteinträge stellen eine der kommerziell wertvollsten öffentlichen Datenquellen im US-Einzelhandel dar. Selbst einen Bruchteil dieses Katalogs manuell zu überwachen, ist betrieblich nicht realisierbar. Der Umfang erfordert Automatisierung.

2026 gibt es vier Arten von Walmart-Scrapern. Dedizierte Walmart-Scraper-APIs enthalten vorgefertigte Parsing-Logik, die speziell auf Walmarts Seitenstruktur zugeschnitten ist. Allgemeine Scraping-APIs funktionieren auf jeder Website einschließlich Walmart. Proxy-basierte benutzerdefinierte Scraper ermöglichen es Engineering-Teams, proprietäre Lösungen auf Basis von Residential-IP-Netzwerken zu entwickeln. Vorab gesammelte Walmart-Datensätze liefern Produktdaten in großen Mengen, ohne dass eine Scraping-Infrastruktur erforderlich ist. Das Walmart-Scraping-Tutorial enthält vollständige Python-Code-Walkthroughs für gängige Datenerfassungsmuster.

Wie wir diese Walmart-Scraper bewertet haben

Die Auswahl des richtigen Walmart-Scrapers erfordert Tests unter realen Produktionsbedingungen. Walmarts Anti-Bot-Stack macht es 2026 zu einer der technisch anspruchsvollsten Einzelhandels-Websites.

Überwindet das Tool Walmarts Anti-Bot-Stack?

Walmart kombiniert Akamai Bot Manager mit der Verhaltensanalyse von HUMAN Security und reCAPTCHA. Mehrere unabhängige Scraping-Analysequellen bewerten Walmart 2026 mit einem Schwierigkeitsgrad von 9/10. Wir haben die dokumentierte und durch Benchmarks getestete Erfolgsrate jedes Tools gegen diese kombinierte Verteidigungsschicht bewertet.

Wie viele Felder extrahiert es pro Produkt?

Ein Scraper, der 300 Felder pro Produktseite liefert, bedient andere Anwendungsfälle als einer, der 650+ liefert. Wir haben die Feldanzahl für Produkttitel, Preise, Inventar, Verkäuferdaten, Erfüllung, Bewertungen, Ratings und Schema-Markup verglichen. Die Feldanzahl der überprüften Tools reichte von unter 300 bis über 650 pro Produktseite.

Wie schnell reagiert es auf Anfragen?

Die mittlere Antwortzeit bestimmt, ob ein Tool Echtzeit-Monitoring oder nur Batch-Workloads unterstützt. Wir haben die Latenz von der Anfrageübermittlung bis zur strukturierten Ausgabelieferung verglichen. Die gemessenen Antwortzeiten lagen bei allen überprüften Tools zwischen 2,31 und 11,12 Sekunden.

Was kostet es, Walmart im großen Maßstab zu scrapen?

Wir haben die Kosten pro 1.000 Anfragen, Bezahlung-pro-Erfolg- versus Bezahlung-pro-Anfrage-Abrechnungsmodelle und die Skalierbarkeit für Unternehmen bewertet. Bei einem 9/10-Schwierigkeitsziel hat das Abrechnungsmodell bei Produktionsvolumen überproportionale Kostenauswirkungen.

Die 8 besten Walmart-Scraper im Ranking

Diese acht Tools stellen die stärksten Optionen für die Walmart-Datenextraktion 2026 dar. Die Einstufungen spiegeln die Benchmark-Leistung, Datenvollständigkeit, das Preismodell und die Produktionseignung bei realen Walmart-Workloads wider.

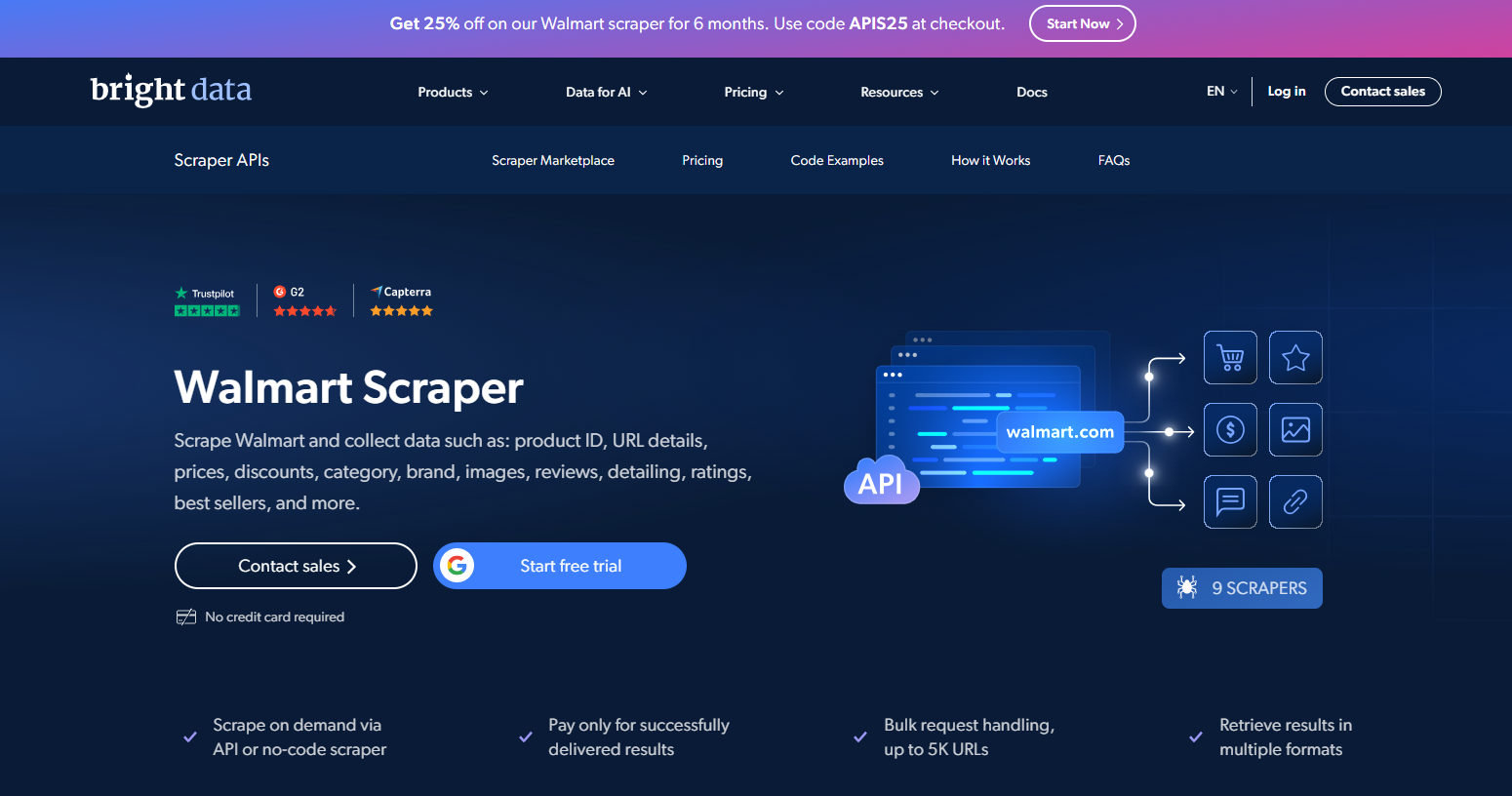

1. Bright Data: Bester Walmart-Scraper insgesamt

Bright Data belegt Platz 1 mit einer durchschnittlichen Erfolgsrate von 98,44 % in einem unabhängigen Benchmark von Scrape.do unter 11 Scraping-Anbietern. Das ist das höchste Ergebnis aller getesteten Anbieter. Der AIMultiple-Walmart-Benchmark hat Bright Data ebenfalls auf Platz 1 eingestuft, basierend auf der besten Balance aus Feldanzahl und Antwortzeit über 2.000 Testanfragen auf 200 Walmart-Produkt- und Suchseiten. Der dedizierte Walmart-Scraping-Endpunkt ist speziell für Walmarts Produktstruktur, dynamische Rendering-Anforderungen und mehrschichtige Anti-Bot-Abwehr entwickelt.

Was Bright Data von jedem anderen Tool in dieser Liste unterscheidet, ist die Breite. Bright Data ist keine einzelne Scraping-API. Es ist eine vollständige Walmart-Datenplattform, die vier verschiedene Produktlinien abdeckt. Dazu gehören ein dedizierter Echtzeit-Scraper, ein vorab gesammelter Datensatz mit 267 Millionen Einträgen, ein MCP-Server für KI-Workflows und ein verwalteter Cloud-Browser für JavaScript-intensive Seiten.

Dedizierte Walmart-Scraper-API

Die Web-Scraping-API enthält einen Walmart-Endpunkt. Er deckt Produktseiten, Suchergebnisse, Kategorielisten, Verkäuferprofile, Bewertungen und Inventardaten ab. Er gibt strukturiertes JSON aus, ohne dass benutzerdefinierter Parsing-Code erforderlich ist. Abgedeckte Felder umfassen Produkttitel, URL, SKU, GTIN-Identifikatoren, Preise und Verfügbarkeit. Dazu kommen Verkäufernamen, Erfüllungsoptionen, Spezifikationen, Bild-URLs, Bewertungen, Sternebewertungen und Breadcrumb-Pfade.

Dieser Endpunkt läuft auf einer Infrastruktur mit 99,99 % Betriebszeit über 437+ vorgefertigte Scraper. Das Bezahlung-pro-Erfolg-Modell berechnet 1,50 $ pro 1.000 erfolgreiche Anfragen. Wenn Walmart eine Anfrage blockiert, kostet dieser Versuch nichts. Bei einem 9/10-Schwierigkeitsziel reduziert dieses Modell die Kostenungewissheit im Vergleich zu Bezahlung-pro-Anfrage-Alternativen erheblich.

Vorab gesammelte Walmart-Datensätze

Für Teams, die umfangreiche historische Daten ohne Scraping-Infrastruktur benötigen, enthält der vorab gesammelte Walmart-Datensatz 267 Millionen Produktdatensätze. Datensätze sind in den Formaten CSV, JSON, XLSX oder ndJSON verfügbar. Lieferoptionen umfassen AWS S3, Google Cloud Storage und Azure Blob Storage. Die Preise beginnen bei 250 $ pro 100.000 Datensätze.

Dies ist der schnellste Weg zu großmaßstäblichen Walmart-Daten für Teams, die sich auf Analysen statt auf Infrastruktur konzentrieren. Der Datensatz wird nach einem festgelegten Zeitplan aktualisiert und ist für eine On-Demand-Aktualisierung verfügbar. KI-Trainingspipelines, Preismodellentwicklung und Katalog-Benchmarking-Workflows sind die primären Anwendungsfälle.

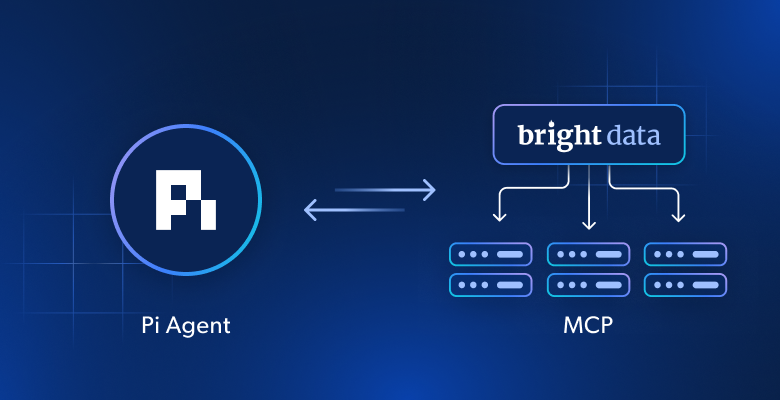

Walmart-MCP-Server

Der Walmart-MCP-Server ermöglicht die Echtzeit-Datenextraktion innerhalb von KI-Agenten- und Large-Language-Model-Workflows. Er verbindet LLM-Systeme mit Live-Walmart-Produktdaten, ohne dass eine separate API-Integrationsschicht erforderlich ist. Kein anderer hier besprochener Anbieter bietet einen speziell entwickelten Walmart-Datenkonnektor für KI-Agentenarchitekturen an.

Für KI-gestützte Preis- oder Katalogüberwachung eliminiert der MCP-Server eine gesamte Integrationsschicht. Daten fließen direkt von Walmart in den Agentenkontext, ohne zwischengeschaltete Transformationsschritte.

Scraping-Browser

Bright Datas Scraping-Browser übernimmt JavaScript-Rendering, CAPTCHA-Lösung und Fingerabdruck-Umgehung automatisch. Er überwindet Akamai Bot Manager, HUMAN Security und PerimeterX ohne clientseitige Konfiguration. Walmarts React-geladene Produktpreise, Inventarindikatoren und Erfüllungsoptionen sind über diesen Ansatz vollständig zugänglich.

Auf der Client-Seite ist keine Headless-Browser-Infrastruktur erforderlich. Der Browser läuft in Cloud-Größenordnung mit verwalteter IP-Rotation. Für Teams, die Browser-basierte Zuverlässigkeit wünschen, beseitigt dieser Ansatz den Overhead der Verwaltung von Playwright- oder Puppeteer-Clustern.

Proxy-Netzwerk und Walmart-spezifische Proxys

Das Proxy-Netzwerk umfasst 400 Millionen ethisch beschaffte Residential-IPs in 195 Ländern. Stadt- und ASN-Level-Targeting werden beide unterstützt. Das dedizierte Walmart-Proxy-Netzwerk verwendet rotierende IPs, die für Walmart.com optimiert sind und Datacenter-Bereiche umgehen, die Akamai blockiert.

Walmart bietet je nach US-Region unterschiedliche Preise und Lagerbestände an. City-Level-IP-Targeting ist kommerziell wichtig für regionale Preisintelligenz und MAP-Compliance-Überwachung. Es ist nicht nur eine Anti-Bot-Maßnahme. Es ist eine Datengenauigkeitsanforderung für jedes Team, das regionale Walmart-Preisunterschiede verfolgt.

Preisgestaltung: Web-Scraping-API ab 0,75 $ pro 1.000 erfolgreiche Anfragen (Bezahlung pro Erfolg). Walmart-Datensätze ab 250 $ pro 100.000 Datensätze. Residential-Proxy-Netzwerk ab 2,50 $ pro GB. Für alle Produkte ist ein kostenloser Test verfügbar. Enterprise-Pläne mit dediziertem Support erfordern einen monatlichen Mindestausgaben von 499 $.

Am besten für: Teams, die produktionsreife Walmart-Daten in großem Maßstab mit maximaler Zuverlässigkeit, Geo-Targeting-Präzision und KI-Workflow-Integration benötigen.

Vorteile:

- ✅ 98,44 % Erfolgsrate im unabhängigen Benchmark unter 11 Anbietern, der höchste getestete Wert

- ✅ Bezahlung-pro-Erfolg-Preisgestaltung: null Kosten für blockierte oder fehlgeschlagene Walmart-Anfragen

- ✅ Dedizierter Walmart-Endpunkt für Produkte, Bewertungen, Inventar und vollständige Verkäuferdaten

- ✅ City-Level-Geo-Targeting für genaue regionale Preis- und Inventarerfassung

- ✅ Vorab gesammelter Datensatz mit 267 Millionen Walmart-Produktdatensätzen für sofortigen Massenzugriff

- ✅ MCP-Server für Echtzeit-Walmart-Daten in KI-Agenten- und LLM-Workflows

Nachteile:

- ❌ Premium-Preisgestaltung im Vergleich zu einfachen Scraping-APIs für einfache oder Niedrigvolumen-Anwendungsfälle

- ❌ Vollständige Produktpalette (Datensätze, Scraping-Browser, Proxys) erfordert separate Produktabonnements

- ❌ Prioritätssupport und Enterprise-Funktionen erfordern einen monatlichen Mindestausgaben von 499 $

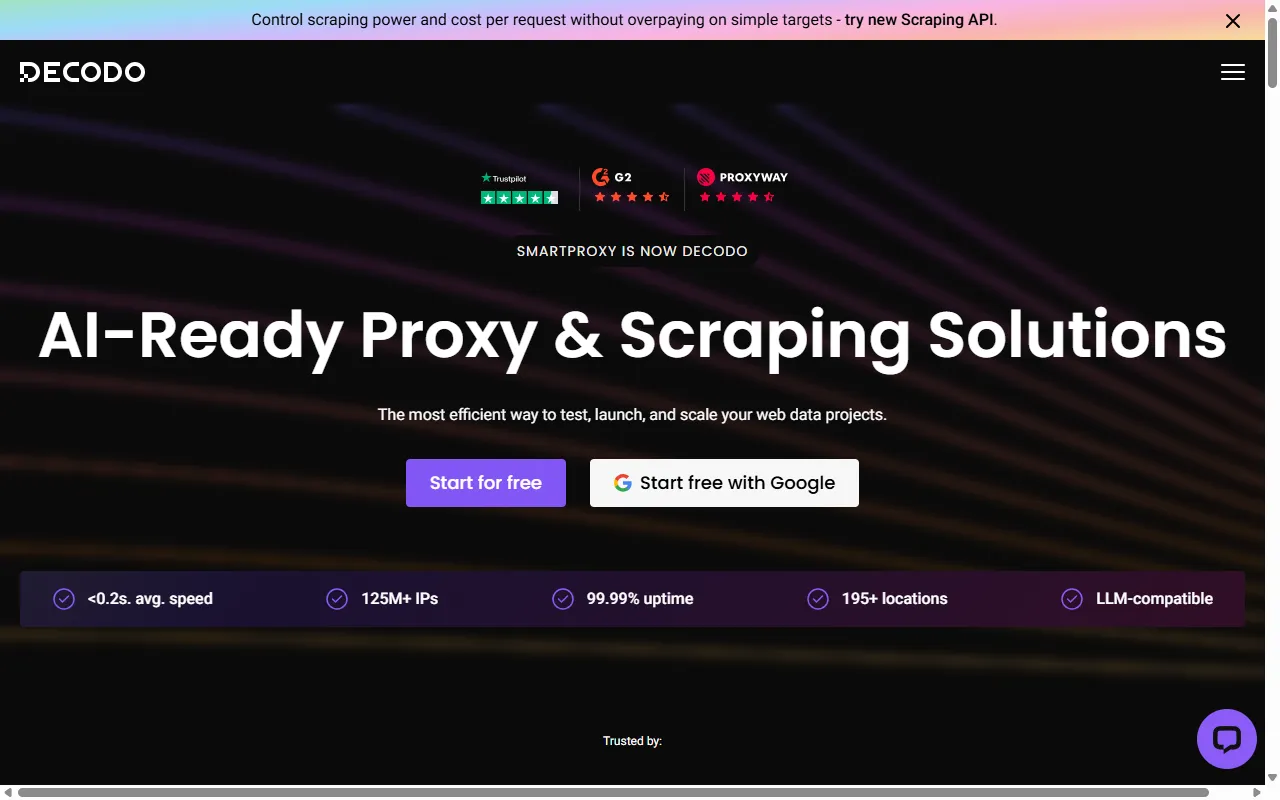

2. Decodo: Bestes Preis-Leistungs-Verhältnis für Walmart-Datenextraktion

Decodo lieferte im AIMultiple-Walmart-Benchmark 650+ Felder pro Produkt, die höchste rohe Anzahl im Test. Der Proxyway-Benchmark verzeichnete eine Erfolgsrate von 99,98 % bei Walmart. Mit 0,25 $ pro 1.000 Anfragen ist Decodo das kosteneffizienteste Enterprise-Tool im Test.

Hauptfunktionen:

- eCommerce-Scraping-API speziell für Walmart und große Einzelhandels-Websites entwickelt

- 650+ Felder pro Walmart-Produktanfrage im AIMultiple-Benchmark-Test

- 99,98 % Erfolgsrate bei Walmart im Proxyway-Benchmark

- Credit-basiertes Modell, bei dem einfachere Anfragen weniger Credits verbrauchen

- Integrierte strukturierte JSON- und CSV-Ausgabe ohne benutzerdefinierte Parsing-Logik

- Benutzerdefinierte und geplante Scraping-Vorlagen für wiederkehrende Walmart-Workflows

Preisgestaltung: Pläne beginnen bei 0,50 $ für 2.000 Anfragen (0,25 $ pro 1.000). Credit-Multiplikatoren gelten für komplexe, bot-geschützte Seiten wie Walmart. Ein 7-tägiger kostenloser Test umfasst 1.000 Ergebnisse. Eine 14-tägige Geld-zurück-Garantie ist enthalten. Geplante Aufgaben und benutzerdefinierte Vorlagen erfordern den Advanced-Abonnementtarif.

Am besten für: Teams, die maximale Feldabdeckung pro Dollar benötigen und mit Geo-Targeting auf Länderebene arbeiten können.

Vorteile:

- ✅ 650+ Felder pro Walmart-Produktseite, die höchste rohe Feldanzahl im Benchmark-Test

- ✅ 99,98 % Erfolgsrate bei Walmart im Proxyway-Benchmark

- ✅ Niedrigster Basispreis unter Enterprise-Tools mit 0,25 $ pro 1.000 Anfragen

Nachteile:

- ❌ Nur Geo-Targeting auf Länderebene; kein Stadt- oder Bundesstaats-Level-Targeting für regionale Walmart-Preisgestaltung

- ❌ Geplante Aufgaben und benutzerdefinierte Vorlagen erfordern den Advanced-Abonnementtarif

- ❌ Abonnementmodell für alle Plantarife erforderlich; keine Pay-as-you-go-Option

3. Oxylabs: Beste Datenvollständigkeit

Oxylabs belegte Platz 2 im AIMultiple-Walmart-Benchmark mit etwa 620 pro Produktseite extrahierten Feldern. Der Proxyway-Benchmark verzeichnete eine Erfolgsrate von 99,88 % und eine mittlere Antwortzeit von 2,84 Sekunden. Der integrierte Web-Crawler für automatisierte Walmart-Kategoriedurchquerung eignet sich für die Katalogextraktion in großem Maßstab.

Hauptfunktionen:

- Etwa 620 Felder pro Walmart-Produktseite im AIMultiple-Benchmark-Test

- 99,88 % Erfolgsrate und 2,84-Sekunden-mittlere Antwortzeit im Proxyway-Benchmark

- OxyPilot-KI-Assistent generiert automatisch Scraping-Anfragen und XPath/CSS-Parsing-Regeln

- Integrierter Crawler für automatisierte Walmart-Kategorie- und Suchergebnisdurchquerung

- Scraper-API-Playground für Live-Code-Generierung und Echtzeit-API-Tests

- Geplantes Aufgabenmanagement für wiederkehrende Walmart-Datenerfassung in großem Maßstab

Preisgestaltung: Pläne beginnen bei 49 $ für 24.500 Ergebnisse (2 $ pro 1.000 Anfragen). Ein 7-tägiger kostenloser Test umfasst 5.000 Ergebnisse. Enterprise-Volumenpreise sind verfügbar. Keine Pay-as-you-go-Option für einmalige Projekte.

Am besten für: Teams, die eine tiefe strukturierte Feldabdeckung über große Walmart-Katalogsegmente mit KI-unterstützter Parsing-Unterstützung benötigen.

Vorteile:

- ✅ 620+ Felder pro Walmart-Produktseite mit KI-unterstütztem Parsing über OxyPilot

- ✅ 99,88 % Erfolgsrate im Proxyway-Benchmark mit 2,84-Sekunden-mittlerer Antwort

- ✅ Integrierter Crawler für automatisierte Walmart-Kategorie- und Listungsdurchquerung

Nachteile:

- ❌ Höchster Preis pro Anfrage unter allen überprüften Tools mit 2 $ pro 1.000 Anfragen

- ❌ Nur Geo-Targeting auf Länderebene; kein Stadt- oder Bundesstaats-Level-Targeting verfügbar

- ❌ Keine Pay-as-you-go-Option für einmalige oder Niedrigvolumen-Walmart-Scraping-Projekte

4. Zyte API: Schnellster Walmart-Scraper

Zyte API verzeichnete im Proxyway-Walmart-Benchmark eine mittlere Antwortzeit von 2,31 Sekunden, die schnellste im Test. Die dualen Integrationsmodi (REST-API und Proxy-Server) ermöglichen die Einführung ohne Änderung der bestehenden Infrastruktur.

Hauptfunktionen:

- 2,31-Sekunden-mittlere Antwortzeit, schnellste im Proxyway-Walmart-Benchmark

- 96,22 % Erfolgsrate auf Walmart-Produkt- und Suchseiten

- REST-API und Proxy-Server-Integration für flexible Einführung in bestehende Stacks

- Cloud-gehostete IDE zum Schreiben und Bereitstellen benutzerdefinierter Interaktionsskripte

- Pay-as-you-go-Abrechnung mit einem Online-Kostenrechner für Projektschätzungen

Preisgestaltung: Pay-as-you-go ab 1 $ pro einfacher Anfrage. JavaScript-Rendering und strukturiertes Parsing werden als separate zusätzliche Posten abgerechnet. Neue Benutzer erhalten 5 $ in kostenlosen Credits. Benutzerdefinierte Enterprise-Preisgestaltung ist verfügbar.

Am besten für: Teams, bei denen Antwortlatenz die primäre Einschränkung ist und eine Walmart-Erfolgsrate von 96 %+ ihre Workload-Anforderungen erfüllt.

Vorteile:

- ✅ 2,31-Sekunden-mittlere Antwortzeit, die schnellste aller überprüften Tools

- ✅ Duale Integrationsmodi minimieren den Migrationsaufwand für bestehende Scraping-Infrastruktur

- ✅ Pay-as-you-go-Abrechnung passt zu variablen Walmart-Scraping-Workload-Mustern

Nachteile:

- ❌ 96,22 % Erfolgsrate ist die niedrigste unter Enterprise-Tools für Walmart im Test

- ❌ Niedrigste Feldextraktionsanzahl für Walmart-Produktseiten unter allen Benchmark-Tools

- ❌ JavaScript-Rendering und strukturiertes Parsing fügen Kosten über den Basisanfragepreis hinaus hinzu

5. ScraperAPI: Beste Budget-Option für Walmart-Scraping

ScraperAPI erzielte mit 99,98 % im Proxyway-Benchmark die höchste Erfolgsrate bei Walmart. Die Endpunkte von ScraperAPI decken Walmart-Suche, Produktseiten, Kategorien und Bewertungen zu einem vorhersehbaren monatlichen Preis ab.

Hauptfunktionen:

- 99,98 % Erfolgsrate bei Walmart im Proxyway-Benchmark

- Dedizierte Walmart-Endpunkte: Suchergebnisse, Produktseiten, Kategorielisten und Bewertungen

- Strukturierte JSON- und CSV-Ausgabe über Webhook oder Dateidownload

- Vier Integrationsmodi: Proxy-Server, SDK, offene Verbindung und asynchrone Verarbeitung

- 7-tägiger kostenloser Test mit 5.000 Credits ohne Kosten enthalten

Preisgestaltung: Pläne beginnen bei 49 $ pro Monat für 100.000 API-Credits. Walmarts Bot-Schutzschicht wendet Credit-Multiplikatoren an, die das effektive Anfragevolumen pro Plan reduzieren. Geo-Targeting auf Länderebene ist auf den höchstpreisigen Plantarif beschränkt.

Am besten für: Budgetbewusste Teams, die dedizierte Walmart-Endpunktabdeckung zu einem vorhersehbaren monatlichen Preis benötigen.

Vorteile:

- ✅ 99,98 % Erfolgsrate bei Walmart, entspricht den Spitzenreitern im Benchmark-Test

- ✅ Dedizierte Walmart-Endpunkte für Suche, Produktseiten, Kategorien und Bewertungen

- ✅ Vier Integrationsmodi einschließlich Proxy-Server für bestehende Scraping-Setups

Nachteile:

- ❌ 5,04-Sekunden-mittlere Antwortzeit ist unter den langsamsten aller überprüften Tools

- ❌ Geo-Targeting auf Länderebene auf den höchsten Plantarif beschränkt

- ❌ Credit-Multiplikatoren für Walmarts Bot-Schutz reduzieren das effektive Volumen pro Plan erheblich

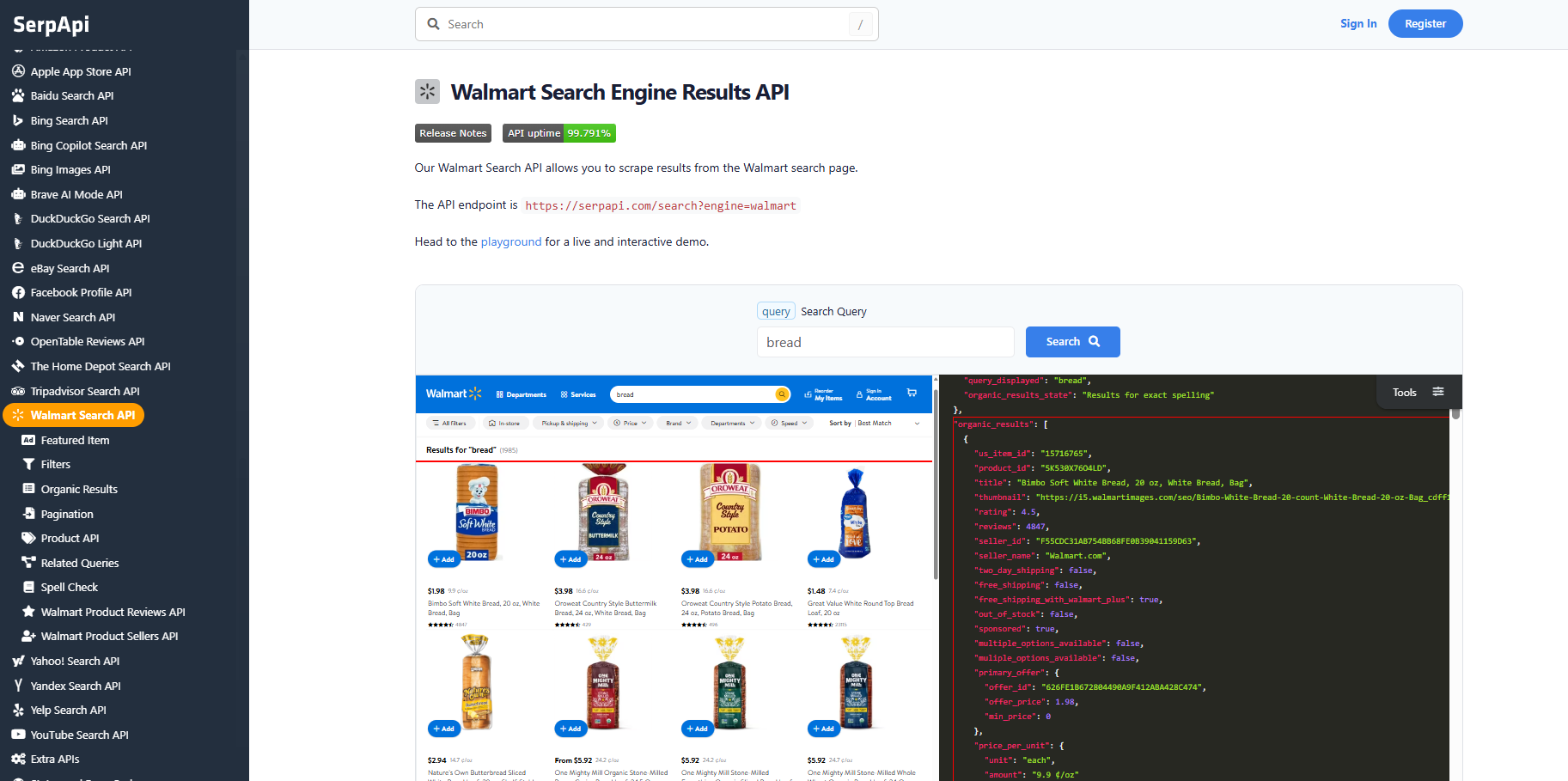

6. SerpApi: Beste Walmart-Suchdaten

Die dedizierte Walmart-Such-API von SerpApi gibt strukturiertes JSON für Suchergebnisse und einzelne Produktseiten zurück. Sie extrahiert Produkt-IDs, Titel, Preise, Thumbnails, Bewertungen, Rezensionszählungen, Verkäuferinfos und Versandindikatoren. Die kostenlose Stufe mit 250 Suchen pro Monat erfordert keine Kreditkarte und ist der reibungsloseste Einstieg für Walmart-Suchen.

Hauptfunktionen:

- Dedizierte Walmart-Such-API mit strukturierter JSON-Ausgabe

- Extrahiert Produkt-IDs, Titel, Preise, Thumbnails, Bewertungen, Rezensionszählungen und Verkäuferinfos

- Unterstützt organische Suchergebnisse, hervorgehobene Artikel, Filterdaten und Produktseiten

- 250 kostenlose Suchen pro Monat ohne Kreditkarte erforderlich

Preisgestaltung: Kostenlose Stufe umfasst 250 Suchen pro Monat. Bezahlte Pläne beginnen bei etwa 50 $ pro Monat für 5.000 Suchen. Verbrauchsbasierte Enterprise-Preisgestaltung ist für Hochvolumen-Anforderungen verfügbar.

Am besten für: Teams, die sich auf Walmart-Suchergebnis-Intelligence, SERP-Monitoring und keyword-basiertes Produktsichtbarkeits-Tracking konzentrieren.

Vorteile:

- ✅ 250 kostenlose Suchen pro Monat ohne Kreditkarte erforderlich

- ✅ Hochstrukturiertes JSON für Suchergebnis- und einzelne Produktseitendaten

- ✅ Minimaler Integrationsaufwand für suchfokussierte Walmart-Workflows

Nachteile:

- ❌ Nicht für die Massenkatalogeextraktion, Inventarüberwachung oder tiefes Bewertungs-Mining entwickelt

- ❌ Unterstützt keine Verkäufer-Tiefenanalyse, Kategorie-Crawling oder MAP-Compliance-Workflows

- ❌ Höhere Kosten pro Anfrage als allgemeine APIs bei Skalierung auf Zehntausende von Anfragen

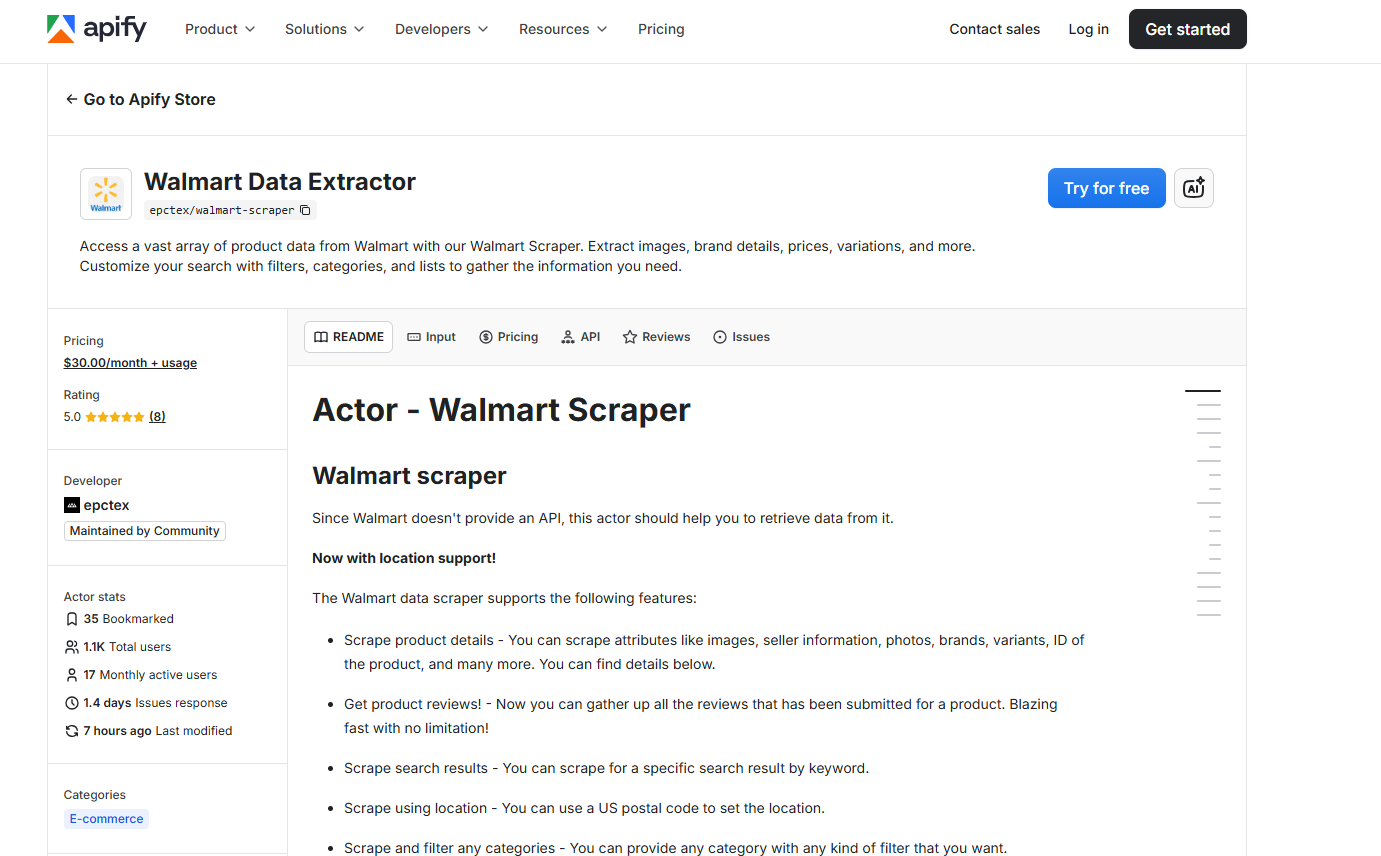

7. Apify: Beste individuelle Walmart-Workflows

Apifys Walmart-Scraper-Actor deckt Produkte, Preise, Bewertungen und Inventar mit einer dokumentierten Erfolgsrate von 95 %+ ab. Das offene SDK ermöglicht es Teams, die Scraping-Logik für nicht standardmäßige Datenanforderungen über den Standard-Actor hinaus zu erweitern.

Hauptfunktionen:

- Walmart-Scraper-Actor deckt Produkte, Preise, Bewertungen und Inventar ab

- 95 %+ Erfolgsrate auf Walmart-Produkt- und Suchseiten gemäß Apifys veröffentlichten Metriken

- Offenes Apify-SDK ermöglicht benutzerdefinierte Scraping-Logik und Actor-Erweiterung

- Kostenlose Stufe umfasst monatliche Plattform-Compute-Credits

- Native Planung, Webhook-Callbacks und Unterstützung mehrerer Ausgabeformate

Preisgestaltung: Kostenlose Stufe umfasst monatliche Compute-Credits. Bezahlte Pläne beginnen bei 49 $ pro Monat. Der Walmart-Scraper-Actor wird nach verbrauchten Compute-Einheiten pro Lauf abgerechnet, ohne langfristige Verpflichtung.

Am besten für: Engineering-Teams, die anpassbare Walmart-Scraping-Workflows mit Planung und Webhook-Integration benötigen.

Vorteile:

- ✅ Offenes SDK ermöglicht benutzerdefinierte Logik für nicht standardmäßige Walmart-Datenerfassungsanforderungen

- ✅ Native Planung und Webhook-Callbacks für automatisierte Pipeline-Integration

- ✅ Keine langfristige Verpflichtung unter dem Compute-Einheiten-Abrechnungsmodell erforderlich

Nachteile:

- ❌ 95 %+ Erfolgsrate ist niedriger als dedizierte Walmart-API-Anbieter bei Produktionsvolumen

- ❌ Höhere Compute-Kosten pro Datensatz als dedizierte APIs für Walmart-Workloads mit hohem Volumen

- ❌ Das Anpassen von Actors über die Standardeinstellungen hinaus erfordert Apify-SDK-Kenntnisse und Entwicklungszeit

8. Nimbleway: Bestes geo-gezieltestes Walmart-Scraping

Nimbleway erzielte im Proxyway-Benchmark 99,98 % Erfolg bei Walmart und bietet Geo-Targeting auf Stadt- und Bundesstaatsebene. Diese Kombination eignet sich für Teams mit regionalen Walmart-Preisanforderungen, die Bright Datas vollständige Suite nicht benötigen.

Hauptfunktionen:

- 99,98 % Erfolgsrate bei Walmart im Proxyway-Benchmark

- Geo-Targeting auf Stadt- und Bundesstaatsebene für regionale Walmart-Preis- und Inventardaten

- KI-gestützte Verhaltensimitation für Walmarts kombinierte Anti-Bot-Abwehr

- Stapelverarbeitung von bis zu 1.000 Walmart-URLs gleichzeitig

- Integrierter strukturierter JSON-Ausgabe-Parser ohne benutzerdefinierte Konfiguration erforderlich

Preisgestaltung: Beginnt bei 3 $ pro 1.000 Ergebnisse. Pay-as-you-go- und Abonnementmodelle sind beide verfügbar. Benutzerdefinierte JavaScript-Ausführung und Header-Kontrolle erfordern höhere Plantarife. Ein kostenloser Test ist verfügbar.

Am besten für: Teams mit Geo-Targeting-Anforderungen auf Stadtebene für regionale Walmart-Preis- und Inventar-Intelligence.

Vorteile:

- ✅ 99,98 % Erfolgsrate bei Walmart, entspricht den Spitzenreitern im Proxyway-Benchmark

- ✅ Geo-Targeting auf Stadt- und Bundesstaatsebene für genaue regionale Walmart-Datenerfassung

- ✅ Stapelverarbeitung von bis zu 1.000 Walmart-URLs pro gleichzeitigem Job

Nachteile:

- ❌ 11,12-Sekunden-mittlere Antwortzeit ist die langsamste aller überprüften Tools

- ❌ Unbegrenzte gleichzeitige Anfragen auf die zwei teuersten Plantarife beschränkt

- ❌ Höherer Einstiegspreis als ScraperAPI und Apify für grundlegende Walmart-Scraping-Workloads

Vergleichstabelle Seite an Seite

Die folgende Tabelle fasst alle 8 überprüften Walmart-Scraper zusammen, einschließlich Benchmark-Zuverlässigkeitsdaten für den direkten Vergleich.

| Tool | Am besten für | Startpreis | Kostenloser Test |

|---|---|---|---|

| Bright Data | Bestes Gesamtpaket | 0,75 $/1K Anfragen + doppelte Mittel bis 500 $ | 7-tägiger Business-Test |

| Decodo | Bestes Preis-Leistungs-Verhältnis | 0,25 $/1K Anfragen | 7-Tage-Test, 1.000 Ergebnisse |

| Oxylabs | Beste Datenvollständigkeit | 2 $/1K Anfragen | 7-Tage-Test, 5.000 Ergebnisse |

| Zyte API | Schnellste Antwortzeit | 1 $+ pro Anfrage | 5 $ in kostenlosen Credits |

| ScraperAPI | Beste Budget-Option | 49 $/Monat | 7-Tage-Test, 5.000 Credits |

| SerpApi | Beste Suchdaten | ~50 $/Monat | 250 Suchen/Monat kostenlos |

| Apify | Beste individuelle Workflows | 49 $/Monat | Monatliche Compute-Credits |

| Nimbleway | Bestes Geo-Targeting | 3 $/1K Ergebnisse | Test verfügbar |

So wählen Sie den richtigen Walmart-Scraper

Vier Faktoren bestimmen den richtigen Walmart-Scraper: Datenaktualität, Anti-Bot-Fähigkeit, Geo-Targeting-Präzision und technisches Niveau des Teams. Jeder Faktor kann Kategorien von Tools sofort ausschließen.

Welches Datenaktualitätsniveau benötigen Sie?

Echtzeit-Preisüberwachung erfordert eine Scraping-API, die innerhalb von Sekunden strukturierte Ausgaben liefert. Batch-Analysen historischer Preise und Katalogänderungen funktionieren gleichermaßen gut mit vorab gesammelten Massendaten. Bright Datas vorab gesammelter Walmart-Datensatz enthält 267 Millionen Datensätze, die nach einem festgelegten Zeitplan aktualisiert werden. Er aktiviert schneller als jede API-basierte Pipeline. Er kostet weniger, wenn tägliche oder wöchentliche Aktualität gegenüber stündlichem Polling ausreicht.

Kann das Tool Walmarts Abwehr in großem Maßstab überwinden?

Walmart wird mit einem Scraping-Schwierigkeitsgrad von 9/10 bewertet. Enterprise-Tools einschließlich Bright Data, Oxylabs und Decodo überwinden Akamai Bot Manager und HUMAN Security automatisch. Budget-Tools erfordern möglicherweise ergänzende Residential-Proxy-Infrastruktur, um akzeptable Erfolgsraten bei Volumen aufrechtzuerhalten. Eine Erfolgsrate von 96 % gegenüber 99,98 % bedeutet 20-mal mehr fehlgeschlagene Anfragen pro 100.000 Versuche. Bei Enterprise-Volumen wird dieser Unterschied zu einer materiellen Kosten- und Zuverlässigkeitslücke, die sich über die Zeit zusammensetzt.

Benötigen Sie Geo-Targeting auf Stadtebene?

Walmart bietet je nach US-Region unterschiedliche Preise und Lagerbestände an. Geo-Targeting auf Länderebene reicht für eine genaue regionale Preisdatenerfassung nicht aus. Bright Data und Nimbleway unterstützen beide Targeting auf Stadt- und Bundesstaatsebene. Decodo und Oxylabs bieten nur Targeting auf Länderebene. Für regionale MAP-Compliance oder lokale Preisvergleiche schließt die Präzision auf Stadtebene mehrere Tools sofort aus der Betrachtung aus.

Wie technisch ist Ihr Team?

Nicht-Entwickler können Walmart-Sammlungen mit Bright Datas No-Code-Web-Scraper-IDE konfigurieren. Es unterstützt Point-and-Click-Feldauswahl und geplante CSV-Lieferung ohne eine einzige Zeile Code zu schreiben. Teams, die Daten ohne Scraping-Infrastruktur benötigen, können den Walmart-MCP-Server nutzen oder vorab gesammelte Datensätze direkt herunterladen. Engineering-Teams können über den Proxy-Server-Modus oder die REST-API integrieren, die bei allen überprüften Tools verfügbar sind. Die Wahl des Integrationsmodus sollte zur aktuellen Infrastruktur passen, nicht deren Neuaufbau erfordern.

Häufige Anwendungsfälle für Walmart-Daten

Walmart-Scraping bedient 2026 fünf primäre kommerzielle Anwendungsfälle, die Wettbewerbsanalyse, Markenschutz, Kataloganalyse und KI-Modellentwicklung umfassen.

Wettbewerbliche Preisüberwachung

81 % der US-Händler nutzen automatisiertes Preis-Scraping für dynamische Neupreisgestaltung, gegenüber 34 % im Jahr 2020. Walmarts Rollback-Preisgestaltung, Flash Picks und innertägliche Werbeformate ändern sich in Hochgeschwindigkeitskategorien häufig. Preise für Unterhaltungselektronik und Gaming-Hardware können sich mehrmals täglich ändern. Händler überwachen diese Änderungen und passen ihre eigene Preisgestaltung nahezu in Echtzeit an. Der Walmart-Preisverfolger bietet Teams eine strukturierte Überwachungslösung ohne Verwaltung von Scraping-Infrastruktur.

MAP-Compliance-Überwachung

Marken mit MAP-Richtlinien müssen nicht autorisierte Walmart-Marketplace-Verkäufer identifizieren, die vereinbarte Preisuntergrenzen unterbieten. Die manuelle Überwachung eines großen SKU-Katalogs ist nicht in großem Maßstab durchführbar. Automatisiertes Scraping von Verkäufernamen, Listenpreisen und Produktdetails ist der einzige skalierbare Ansatz. Bright Data und ScraperAPI geben strukturierte Verkäufernamen, Bewertungen und Preise in einem einzigen Walmart-API-Aufruf zurück. Dies ermöglicht tägliche MAP-Compliance-Überprüfungen über Tausende von SKUs.

Produktkatalog-Intelligence

Händler nutzen Walmart-Daten, um neue SKU-Einführungen, eingestellte Produkte, Kategorie-Neupositionierungen und Sortimentslücken zu identifizieren. Das Verfolgen von Walmarts Katalog zusammen mit Amazons bietet nahezu vollständige Abdeckung der US-Online-Einzelhandels-Sortimentsänderungen. Für Teams, die mehrere Plattformen überwachen, deckt der Artikel über die besten Amazon-Scraper äquivalente Tools für die Amazon-Datenerfassung ab. Kombiniert liefern Walmart- und Amazon-Katalogdaten Sortimentslückenanalysen über die zwei größten US-Online-Händler.

Bewertungs-Mining und Sentiment-Analyse

Beliebte Walmart-Produkte sammeln Tausende von Kundenbewertungen an. Das Aggregieren von Bewertungen in großem Maßstab ermöglicht es Marken, Zufriedenheitstrends zu verfolgen, Beschwerden zu identifizieren und Qualitätssignale frühzeitig zu erkennen. Vollwertige Tools geben Bewertungstext, Sternebewertungen, Rezensenten-Metadaten und Datumsstempel in strukturierter Ausgabe zurück. Sentiment-Analyse-Pipelines und LLM-Klassifikatoren laufen direkt auf diesen strukturierten Bewertungsdaten ohne zusätzliche Transformation.

KI- und LLM-Trainingsdaten

Der Web-Scraping-Markt wird 2026 auf 1,17 Milliarden Dollar geschätzt. Er soll bis 2031 mit einer CAGR von 13,78 % 2,23 Milliarden Dollar erreichen. Die Nachfrage nach KI-Trainingsdaten ist einer der primären Wachstumstreiber. Walmart-Produktdatensätze, Preishistorien und Bewertungstexte speisen Preismodelle, Nachfrageprognose-Systeme und LLMs. Bright Data bedient 75 % des KI-Trainingsdaten-Traffics über seine Infrastruktur. Vorab gesammelte Walmart-Datensätze sind der schnellste Aktivierungsweg für groß angelegte Trainingspipelines. Die Echtzeit-API eignet sich für Systeme, die kontinuierlich aktualisierte Daten für laufendes Modell-Feintuning benötigen.

Wichtige technische Herausforderungen beim Scrapen von Walmart

Walmart wird von mehreren unabhängigen Quellen mit einem Scraping-Schwierigkeitsgrad von 9/10 bewertet. Vier technische Herausforderungen definieren, was produktionsreife Tools von Lösungen unterscheidet, die unter realen Bedingungen scheitern.

Warum ist Walmart so schwer zu scrapen?

Walmart setzt drei überlappende Verteidigungsschichten gleichzeitig ein. Akamai Bot Manager analysiert Geräte-Fingerabdrücke, TLS-Signaturen und JavaScript-Ausführungsverhalten am Netzwerkrand. HUMAN Security führt Verhaltensanalysen durch, um nicht-menschliche Anfragemuster über Sitzungen und IP-Adressen hinweg zu erkennen. reCAPTCHA fügt eine Reibungsschicht für Sitzungen hinzu, die von einem der vorgelagerten Systeme markiert wurden. Einfache Python-Anfragen und einfache Headless-Browser werden fast sofort blockiert. Nur speziell entwickelte Tools, die Verhaltensimitation, verwaltete Browser und Premium-Residential-Proxys kombinieren, überwinden alle drei Verteidigungsschichten.

Warum ist JavaScript-Rendering für Walmart wichtig?

Walmart baut seine Produktseiten mit React. Preise, Inventarstatus, gesponserte Listings und Erfüllungsoptionen werden alle dynamisch nach dem ersten Seitenaufruf geladen. Ein statischer HTML-Scraper ruft nur die anfängliche Seitenhülle ab. Er verpasst den Großteil der kommerziell nützlichen strukturierten Daten. Headless-Browser-Rendering ist eine nicht verhandelbare Anforderung für die vollständige Walmart-Produktdatenextraktion. Ein verwalteter Scraping-Browser übernimmt Rendering, Fingerabdruck-Umgehung und CAPTCHA-Lösung in einer Cloud-Umgebung. Er entfernt das gesamte Headless-Browser-Infrastrukturmanagement von der Client-Seite.

Welcher Proxy-Typ funktioniert für Walmart?

Akamais Bot-Erkennung identifiziert und blockiert Datacenter-IP-Bereiche mit hoher Genauigkeit. Residential-Proxys von echten ISP-zugewiesenen IPs sind deutlich schwerer zu erkennen und zu blockieren bei Produktionsvolumen. Mordor Intelligence berichtet, dass Akamai 82,3 % des automatisierten Traffics auf ausgewählten Walmart-Produktseiten blockieren kann. Dies treibt die Nachfrage nach Premium-Residential-Proxy-Lösungen an. Netzwerke mit 400M+ IPs in 195 Ländern bieten ausreichende Pool-Größe, um hohe Erfolgsraten aufrechtzuerhalten. City-Level-IP-Targeting fügt kommerziellen Wert über die Anti-Bot-Umgehung hinaus hinzu, indem es eine regionsspezifische Walmart-Preiserfassung ermöglicht.

Wie parst man Walmarts mehrschichtige Datenstruktur?

Walmart-Produktdaten befinden sich in drei Quellen: JSON-LD-Schema, React-Zustand und dynamisch gerenderte DOM-Elemente. Ein Scraper, der nur eine Quelle liest, erzeugt unvollständige Datensätze mit fehlenden Schlüsselfeldern. Speziell entwickelte Walmart-Scraper reconcilieren alle drei Quellen in einem einheitlichen strukturierten Datensatz unter Verwendung mehrschichtiger Parsing-Logik. Dieser Ansatz erzeugt die 600+ Feldanzahlen, die in Benchmark-Tests zu sehen sind. Generische HTML-Parser können diese Feldabdeckung bei Produktionsvolumen nicht zuverlässig replizieren.

Bereit, Walmart-Produktdaten in Produktionsvolumen zu sammeln? Starten Sie einen kostenlosen Test von Bright Data und greifen Sie auf die zuverlässigste Walmart-Scraping-Infrastruktur zu.

Häufig gestellte Fragen

F: Was macht Walmart 2026 so schwer zu scrapen?

Walmart setzt einen mehrschichtigen Anti-Bot-Stack ein: Akamai Bot Manager übernimmt Geräte-Fingerprinting und JavaScript-Ausführungsherausforderungen auf der Netzwerkschicht, HUMAN Security (früher PerimeterX) führt Verhaltensanalysen durch, um nicht-menschliche Muster zu erkennen, und reCAPTCHA fügt eine zusätzliche Reibungsschicht hinzu. Mehrere unabhängige Scraping-Analysequellen bewerten Walmart 2026 mit einem Schwierigkeitsgrad von 9/10. Einfache Python-Anfragen und einfache Headless-Browser werden fast sofort blockiert. Produktionsreife Tools wie Bright Datas Web-Scraping-API und Scraping-Browser sind speziell entwickelt, um diese Systeme automatisch zu überwinden.

F: Benötige ich Residential-Proxys, um Walmart in großem Maßstab zu scrapen?

Ja. Walmarts Akamai Bot Manager identifiziert und blockiert aggressiv Datacenter-IP-Bereiche, die trivial als nicht-residentieller Traffic identifizierbar sind. Residential-Proxys von echten ISP-zugewiesenen IPs sind deutlich schwerer zu erkennen und zu blockieren. Bright Datas Netzwerk von 400M+ Residential-IPs in 195 Ländern mit City-Level-Targeting ist besonders gut für Walmart geeignet, da Walmart unterschiedliche Preise und Inventar nach US-Region anbietet, was City-Level-Targeting kommerziell wichtig macht, über die reine Anti-Bot-Umgehung hinaus.

F: Welche Datenfelder kann ich von Walmart-Produktseiten extrahieren?

Ein vollwertiger Walmart-Scraper kann extrahieren: Produkttitel, URL, SKU- und GTIN-Identifikatoren, aktuellen und ursprünglichen Preis, Währung, Verfügbarkeit und Inventarstatus, Verkäufername und -bewertung, Erfüllungsoptionen (Abholung, Lieferung, Versand), Produktspezifikationen und Attributtabelle, Bild-URLs, Top-Kundenbewertungen, aggregierte Sternebewertung, Bewertungsanzahl, Breadcrumb-Kategoriepfad und Indikatoren für gesponserte Listings. Tools wie Decodo extrahieren 650+ verschiedene Felder pro Produktseite durch Kombination von DOM-Parsing mit eingebettetem JSON-LD und React-Anwendungszustands-Extraktion.

F: Was ist der Unterschied zwischen einer Walmart-Scraper-API und einem Walmart-Datensatz?

Eine Walmart-Scraper-API extrahiert Daten auf Anfrage in Echtzeit: Sie senden eine URL oder ein Produkt-Keyword und erhalten innerhalb von Sekunden strukturierte Daten zurück. Sie ist die richtige Wahl für Preisüberwachung, Inventarbenachrichtigungen und jeden Workflow, der frische Daten nach einem festgelegten Zeitplan erfordert. Ein Walmart-Datensatz (wie Bright Datas 267-Millionen-Datensatz-Sammlung unter /products/datasets/walmart) sind vorab gesammelte, regelmäßig aktualisierte Massendaten, die sofort im CSV-, JSON- oder anderen Formaten zum Download verfügbar sind. Datensätze sind schneller zu aktivieren, erfordern keine Scraping-Infrastruktur und eignen sich besser für groß angelegte historische Analysen, KI-Modelltraining oder Katalog-Benchmarking.

F: Wie oft sollte ich Walmart-Preise scrapen, um wettbewerbsfähig zu bleiben?

Für die meisten Produktkategorien reicht tägliches Scraping aus, um wettbewerbsfähige Neupreisgestaltungsentscheidungen zu unterstützen. Für Hochgeschwindigkeitskategorien wie Unterhaltungselektronik, Gaming-Hardware und Tagesangebote erfasst das Scraping alle 4 bis 6 Stunden innertägige Änderungen zuverlässiger. Walmarts Werbepreisformate (Rollbacks, Clearance, Flash Picks) können sich innerhalb von Stunden ändern, daher sollte die Scraping-Häufigkeit Ihrer Neupreisgestaltungs-Reaktionsgeschwindigkeit entsprechen. Echtzeit-Streaming ist technisch möglich, verursacht aber unverhältnismäßige Infrastrukturkosten im Verhältnis zum marginalen Aktualitätsgewinn für die meisten Anwendungsfälle.

F: Kann ich Walmart scrapen, ohne Code zu schreiben?

Ja. Bright Data bietet eine No-Code-Web-Scraper-IDE an, mit der Sie die Ziel-URL konfigurieren, Felder über eine Point-and-Click-Oberfläche auswählen und CSV- oder JSON-Lieferung planen können, ohne eine einzige Zeile Code zu schreiben. Bright Datas vorab gesammelte Walmart-Datensätze unter /products/datasets/walmart erfordern überhaupt kein Scraping: Die Daten sind bereits gesammelt, strukturiert und bereit zum Herunterladen oder Abfragen über API. Apifys Walmart-Scraper-Actor unterstützt auch die Nutzung durch Nicht-Entwickler über seine webbasierte Actor-Konfigurationsoberfläche.

F: Wie funktioniert die Bezahlung-pro-Erfolg-Preisgestaltung für Walmart-Scraping?

Bezahlung-pro-Erfolg bedeutet, dass Sie nur dann abgerechnet werden, wenn der Scraper ein gültiges, vollständiges Ergebnis zurückgibt. Wenn eine Walmart-Anfrage durch Anti-Bot-Abwehr blockiert wird oder eine Fehlerseite zurückgibt, entstehen für diesen Versuch keine Kosten. Bright Datas Web-Scraping-API verwendet Bezahlung-pro-Erfolg-Preisgestaltung mit 1,50 $ pro 1.000 erfolgreiche Anfragen. Für ein hochschwieriges Ziel wie Walmart reduziert dieses Modell die Kostenungewissheit im Vergleich zur Bezahlung-pro-Anfrage-Preisgestaltung erheblich, bei der Sie unabhängig davon abgerechnet werden, ob der Scraper erfolgreich war oder blockiert wurde.